El aumento de la capacidad de cálculo de los ordenadores y su coste cada vez menor han conseguido que los sistemas predictivos y de clasificación alcancen una capacidad y nivel de precisión increíble, de aplicación en muchos dominios, desde los mercados financieros y el retail hasta la medicina aplicada. Pero esta mayor capacidad, consecuencia de una mayor complejidad de los modelos, trae también consigo una mayor dificultad para explicar los resultados obtenidos, por qué se ha obtenido cierto resultado o se ha tomado cierta decisión. Hay modelos fácilmente explicables, pero son más simples y menos precisos. Tenemos, pues, que decidir en cada caso el compromiso entre explicabilidad y precisión.

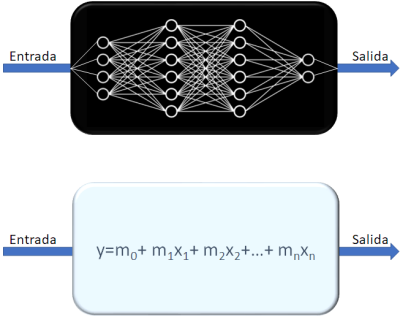

Los sistemas de caja negra, como los sistemas de aprendizaje profundo (redes neuronales), pueden tener miles, millones de parámetros internos, y realizan otras tantas operaciones en cada decisión o predicción, siendo prácticamente imposible interpretar por qué el sistema llega a una conclusión u otra. Los sistemas llamados de caja blanca o transparente son relativamente fáciles de explicar (árboles de decisión o ecuaciones lineales), pudiendo seguir el razonamiento del modelo o calcular el peso de cada variable en la decisión final. Todos los algoritmos de aprendizaje automático que utilicemos caerán entre los extremos de lo inexplicable, como las redes neuronales, y lo totalmente transparente, como una regresión lineal. La elección es nuestra.

Si desarrollamos un modelo complejo para detectar el riesgo de fuga de un cliente, por ejemplo, sabremos que ese riesgo existe, pero será difícil saber qué es exactamente lo que causa esa insatisfacción, y mejor que sea la dirección comercial quien decida cómo actuar tras investigar las causas, y no un sistema que no sabrá la explicación. Cuanto más sencillo sea el modelo más explicable será su respuesta, pero también menos precisa, y si usamos una sencilla regresión lineal para calcular el límite de crédito a un cliente, entenderemos perfectamente lo que aporta cada variable, pero no será muy preciso, y acertaremos casi tanto como si lo decidiésemos lanzando unos dados.

Hay mucho interés en desarrollar inteligencia artifical explicable, y grandes actores, como Google Research o IBM, ya tienen algunos productos disponibles que están dando buenos resultados; pero si andamos apretados de presupuesto, hay soluciones creativas y sencillas para obtener explicaciones igual de sencillas. Será nuestra situación particular, nuestro contexto, el que nos indique dónde posicionarnos entre explicabilidad y precisión.

Image rights:

Image by fullvector on Freepik

Image by Kaziislam691 on Wikipedia Commons